AI用語の基礎知識

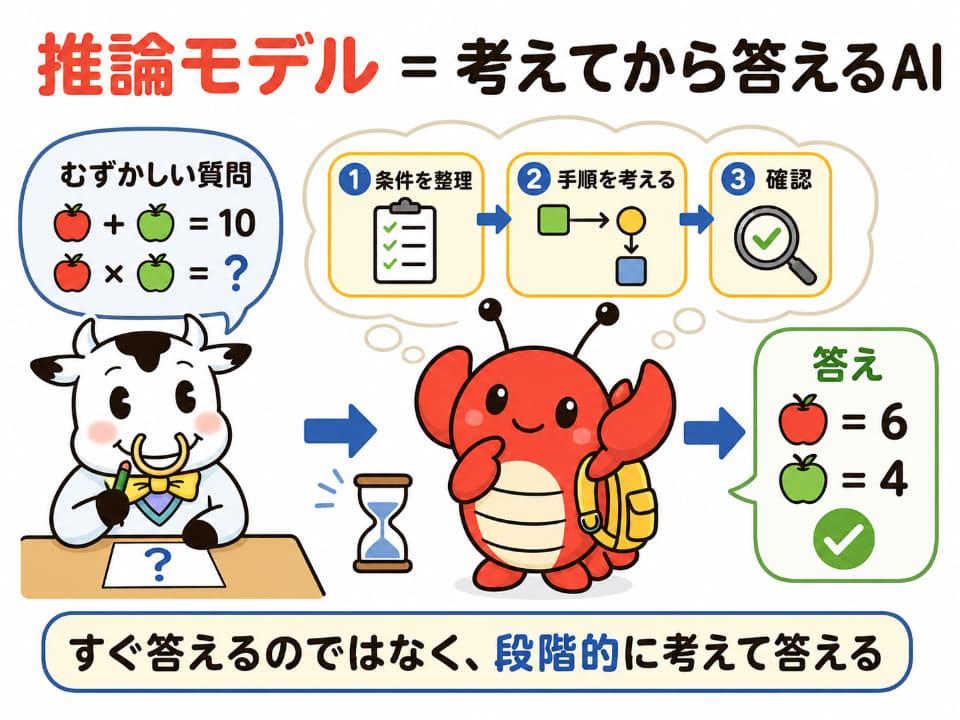

【第5回】推論モデルとは――“考えてから答える”AI

2026年5月11日 07:00

「すぐ答えるAI」から「考えて答えるAI」へ

生成AIというと、質問を入力するとすぐに答えが返ってくるもの、というイメージを持つ人が多いでしょう。しかし最近は、回答までに少し時間をかけ、「考えてから答える」タイプのAIが注目されています。これが「推論モデル(Reasoning Model)」と呼ばれるものです。

たとえば、東京大学・京都大学の二次試験問題を最新AIに解かせる検証では、ChatGPT 5.2 ThinkingやGemini 3 Pro Previewが、東大の全科類、京大のほぼ全学部・学科で合格者最高点を上回ったと報じられています。数学を中心に満点科目もあったとのことで、AIの推論能力が急速に伸びていることを示す結果といえるでしょう。

(ニュース:最新AIが東大・京大の二次試験問題の合格者最高点を突破、満点科目も)

このような結果は、単にAIの知識量が増えたからだけではありません。難しい問題をいきなり答えるのではなく、手順に分けて考えるようになったことが大きいのです。

推論モデルとは何か

推論モデルとは、複雑な問題に対して、すぐに結論を出すのではなく、複数の手順を踏んで答えを導こうとするAIモデルのことです。

たとえば数学の問題であれば、いきなり答えを書くのではなく、「まず条件を整理する」「次に必要な式を立てる」「途中結果を確認する」といった形で、段階的に考えます。プログラミングであれば、仕様を読み取り、必要な処理を分解し、コードを書き、場合によってはテストまで行ないます。

人間が難問を解くときにも、紙に途中式を書いたり、条件を整理したりします。それに近いことをAIに行なわせる考え方だと捉えるとわかりやすいでしょう。

CoTとは何か

推論モデルを理解する上でよく出てくる言葉に、「CoT(Chain-of-Thought:思考の連鎖)」があります。

CoTとは、AIに結論だけでなく、途中の考え方を段階的に組み立てさせる手法です。たとえば「ステップバイステップで考えてください」と指示すると、AIが問題を細かく分けて考えやすくなることがあります。

ただし、現在の推論モデルが内部でどのように考えているかは、外から完全に見えるわけではありません。CoTは重要な考え方のひとつですが、「推論モデルの中身は全部CoTで説明できる」と考えるのは少し単純化しすぎです。

実際には、複数の解き方を試す、途中結果を検証する、よりよさそうな答えを選ぶ、といった仕組みも組み合わされていると考えられます。

推論にはコストがかかる

推論モデルは、数学、プログラミング、論理的な分析、複雑なビジネス判断などに強みを発揮します。一方で、考える時間が長くなるほど、計算資源も多く使います。

AIに長く考えさせるということは、それだけ多くのトークンを処理し、データセンターの計算機を長く動かすということでもあります。実際、GitHub Copilotは2026年6月1日から、トークン消費量に基づく「GitHub AIクレジット」制へ移行すると発表しています。AIが高度化するほど、料金体系も「どれだけ使ったか」に近づいていくわけです。

何でも推論モデルに任せればよい?

では、すべての質問を推論モデルに投げればよいのでしょうか。必ずしもそうではありません。

簡単な質問や、すぐ答えが欲しい場面では、通常の高速なモデルで十分です。一方、数学、設計、コード修正、複数条件の比較、重要な判断の下準備などでは、推論モデルが力を発揮します。

つまり、推論モデルは「いつでも使う高級モード」というより、「難しい問題をじっくり考えさせたいときのモード」と考えるのがよいでしょう。

AIは、ただ答えるだけの道具から、考える過程まで支援する道具へと進化しつつあります。その変化を象徴するキーワードが、この「推論モデル」なのです。

![CORSAIR DDR5-6000MHz デスクトップPC用メモリ VENGEANCE RGB DDR5シリーズ (PC5-48000) Intel XMP メモリキット 32GB ホワイト [16GB×2枚] CMH32GX5M2E6000C36W 製品画像:3位](https://m.media-amazon.com/images/I/31ibrqUfKAL._SL160_.jpg)