AI用語の基礎知識

【第2回】「ハルシネーション」とは――AIが「嘘」をつく理由

2026年4月20日 08:40

AIに「スキーの歌の替え歌の歌詞を知っていますか?」と下記のような途中までの歌詞を書いてと聞いてみました。

朝の4時半頃弁当箱ぶら提げて 家を出ていく親父の姿~♪

しかし、どのAIも最後の

あーあーあ光るよー 頭は100ワットー♪

という、こちらの想定した歌詞にたどり着かず。変な聞いたことのない歌詞を表示してくれるんですよね(笑)。それがAIの創作によるものなのか、本当にAIが表示するバージョンが存在するのかは確かめようがないのですが……。

「AIがつく嘘」? それがハルシネーション

ChatGPTをはじめとする生成AIが普及する中で、「幻覚」を意味する「ハルシネーション(Hallucination)」という言葉もよく聞かれるようになりました。これは、AIの分野では事実に基づかない、もっともらしい嘘や誤情報を出力することを指します。

たとえば、存在しない書籍のタイトルや、間違った統計データ、架空の歴史的事実などを、あたかも真実であるかのように自信満々に答えてくることがあります。先ほどの、歌詞も事実に基づかないAIによる創作であれば「ハルシネーション」ということになります。これはAIが意図的に騙そうとしているわけではなく、その構造上発生し得る現象です。

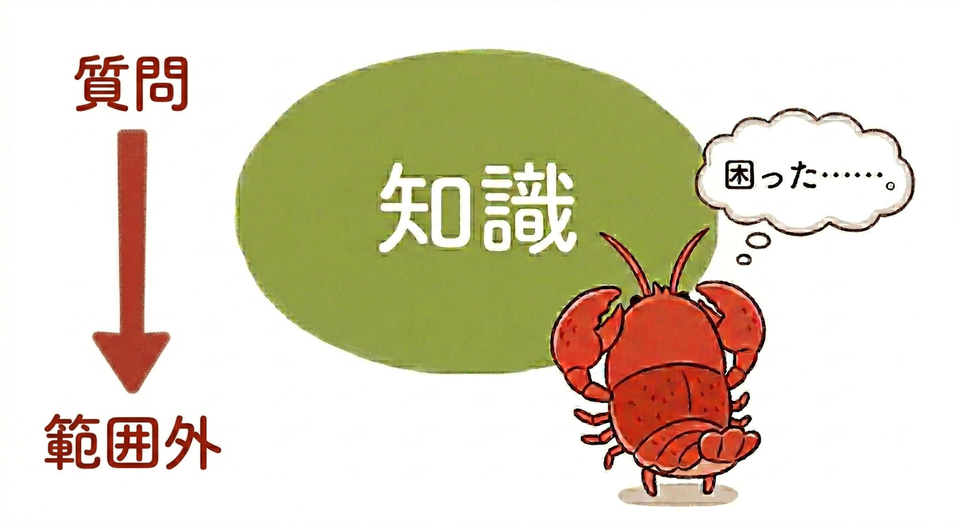

ハルシネーションが起きる原因――知らないことは分からない、故に間違える

なぜAIは、ハルシネーションを起こすのでしょうか。主な原因は、生成AIが構造的に持つ「次にくる最も適切な単語を予測する」という仕組みにあります。

AIは学習した大量のデータの中から、文脈に沿って最も自然な応答を生成しようとします。このとき、たとえば学習データに正確な情報がなかったり、文脈が曖昧だったりする場合でも、「とにかく何かを生成しなければならない」という強い動機が働きます。その結果、事実ではない「でっちあげ」の情報を出力してしまうのです。

また、学習データ自体に偏りや誤り、ユーザーの質問が非常に専門的・ニッチで、AIの知識の守備範囲外の情報が必要になってしまった場合も同様なのは、お分かりですよね。

ハルシネーションへの対策=ファクトチェックを怠らない

ハルシネーションは生成AIの避けられない特性の一つです。ですが、いくつか対策を講じることでリスクを減らすことはできます。

まず、最も重要なのは「AIの出力を鵜呑みにしないこと」です。とくに重要な情報や専門的な内容については、必ずWeb検索や信頼できる情報源で事実確認(ファクトチェック)を行なうことです。

便利なAIですが、「本当にそれ合ってる?」と一度立ち止まる習慣は、これからますます大切になりそうです。なお、ハルシネーションへの技術的な対策としては、「RAG」「グラウンディング」といった仕組みの導入も進んでいます。

![CT2K32G56C46S5 [64GB Kit (32GBx2) Crucial DDR5 5600 (PC5-44800) CL46 Unbuffered SODIMM 262pin] 製品画像:10位](https://m.media-amazon.com/images/I/41ixGGcy29L._SL160_.jpg)