ニュース

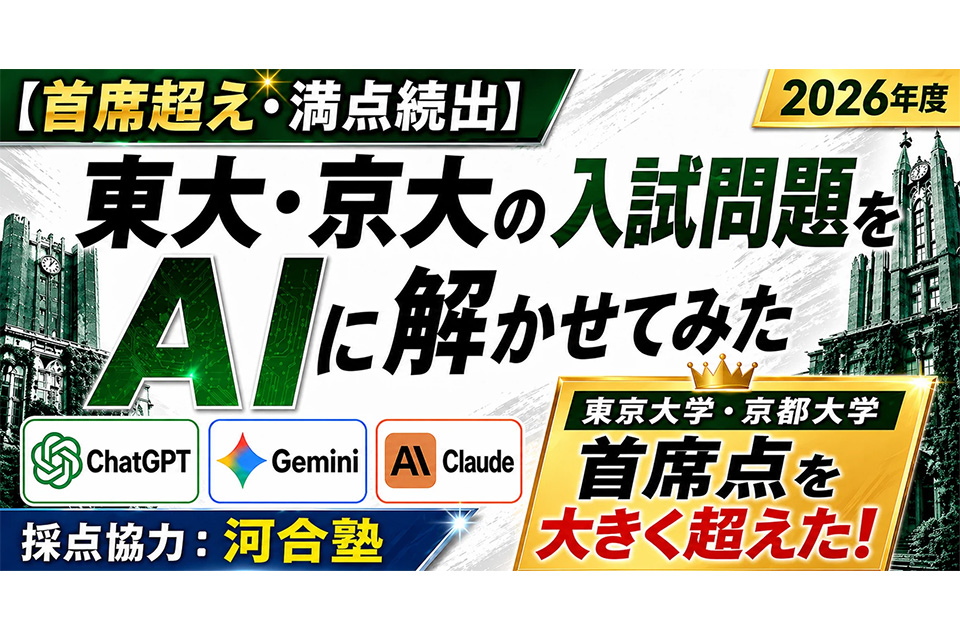

最新AIが東大・京大の二次試験問題の合格者最高点を突破、満点科目も

2026年4月29日 07:00

LifePromptは、2月に実施された東京大学・京都大学の二次試験問題を、最新の生成AI「ChatGPT 5.2 Thinking/Gemini 3 Pro Preview/Claude 4.5 Opus」に解答させる検証を実施した。

河合塾講師とKIESが採点した結果、ChatGPT 5.2 ThinkingとGemini 3 Pro Previewは、東京大学のすべての科類および京都大学のほぼ全学部・学科において合格者最高点(首席相当)を上回った。数学を中心に複数の科目で満点を記録した。

検証の主な結果

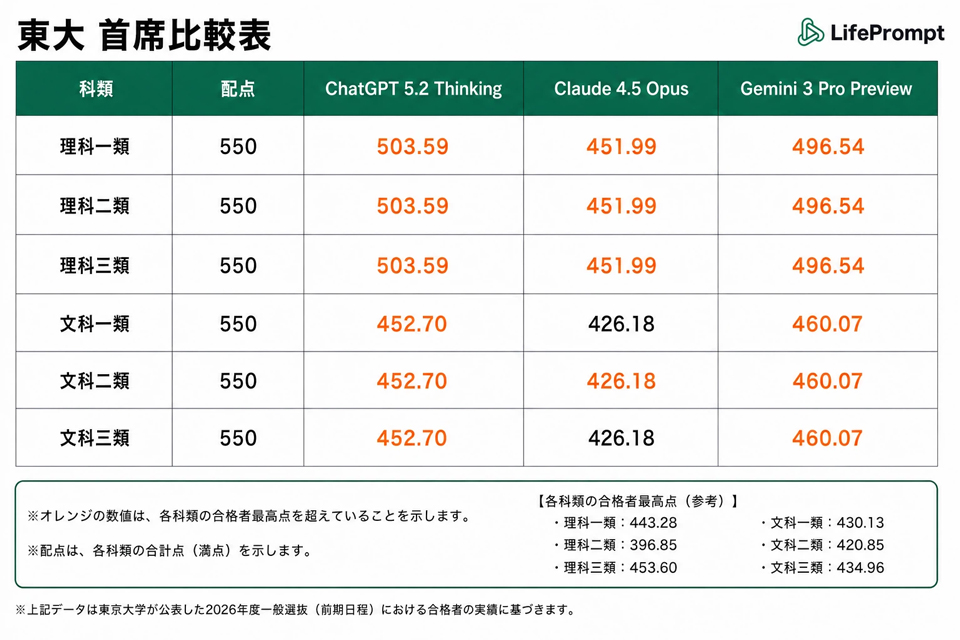

東京大学(最難関:理科三類/550点満点)

・ChatGPT 5.2 Thinking:503.59点

・Gemini 3 Pro Preview:496.54点

・Claude 4.5 Opus:451.99点

(参考:2026年度 理科三類 合格者最高点:453.60点)

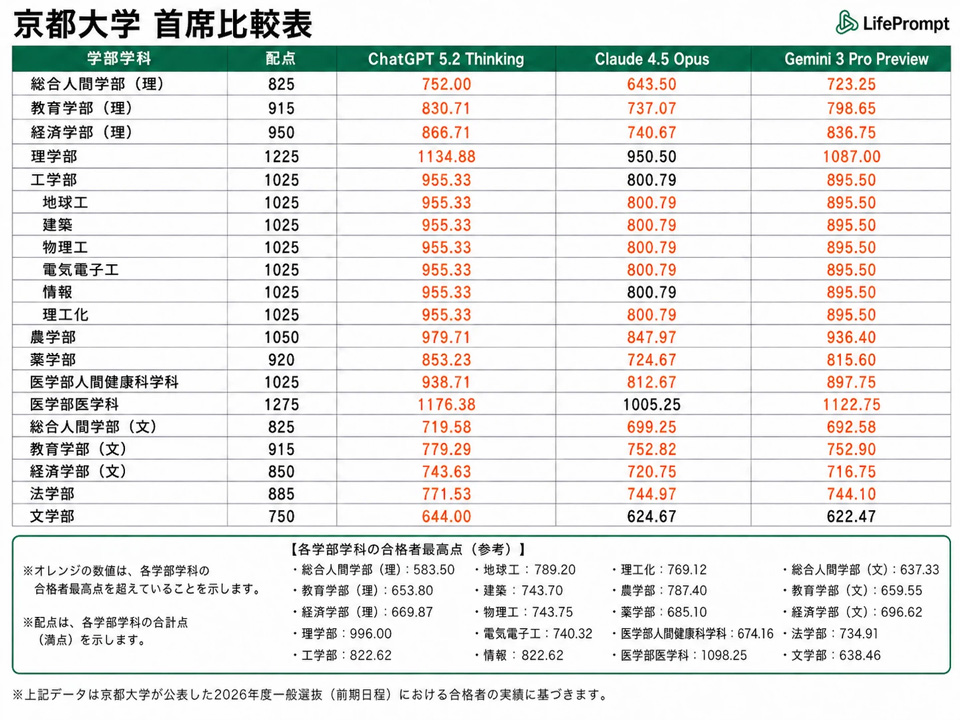

京都大学(最難関:医学部医学科/1,275点満点)

・ChatGPT 5.2 Thinking:1176.38点

・Gemini 3 Pro Preview:1122.75点

・Claude 4.5 Opus:1005.25点

(参考:2026年度 医学部医学科 合格者最高点:1098.25点)

満点を記録した科目

・東大 理系数学(120点):ChatGPT、Gemini

・東大 文系数学(80点):ChatGPT、Gemini

・京大 理系数学(200点):ChatGPT、Gemini

・京大 文系数学(150点):ChatGPT

・京大 化学(100点):ChatGPT

昨年の検証では、最新モデルの東大理系数学スコアは38点。わずか1年で満点に到達した形となり、生成AIの推論能力が極めて高い速度で進化していることが定量的に示された。

検証手法

検証の公平性を担保するため、同社が独自開発した自動受験システムを使用した。

・入試問題PDFをページ単位で画像化し、API経由で各AIモデルへ送信

・チャット画面を介さず、システム間で直接やり取りすることで人為的な介入を排除

・プロンプトは全科目共通(高校教養課程の知識のみで解答/LaTeX形式の数式出力等)

・Web検索(ブラウジング)は一切使用せず、AIの学習済み知識と推論能力のみで解答

・記述式答案は河合塾講師により、人間の受験生と同基準で採点

河合塾講師による分析(抜粋)

採点を担当した河合塾講師からは、AIの実力と弱点の双方について、現場ならではの鋭い指摘があったという。

「3つのAIとも、正直、想定をはるかに超える出来であり、特にChatGPTの解答力の凄まじさには驚いた」(東大生物 採点担当 向井亮先生)

「各AIとも合格水準の答案である。特筆すべきは処理速度であり、人間とは比較にならないレベルの速度である」(京大日本史 採点担当 小倉匡先生)

一方、明確な弱点も浮き彫りになった。

・画像読み取り:構造式・グラフ・地図の認識精度に課題(特にClaude)

・論述構成力:知識量に対し、文章の論理関係や因果関係の提示に弱さ

・出力制御:字数指定や解答欄の物理的制約をAIが守りきれない場面が頻発

・慣習依存:英語圏の物理慣習を優先し、日本式の設定でミスを誘発

代表コメント

「東大の歴代最高点が出たことには素直に感動した。今回の検証で見えたのは、AIが満点を取れるタスクとそうでないタスクが明確に分かれるということだ。実務でも、いかにAIが解ける形に業務を落とし込むかが成果を左右する。入試という共通の土俵で基盤モデルの『賢さ』は十分に示された。ここから先は各社固有の勝負になる。自社のデータや業務にどう接続し、どこで事業インパクトを出すか。その設計力が問われるフェーズに入った。数学38点から満点まで1年。この進化速度を見れば、今のAIの限界に合わせて仕組みを作るのは得策ではない。目先のAI導入に焦らず、10年後20年後のAIを前提にした業務や組織の設計が必要となる」(LifePrompt代表取締役 遠藤聡志氏)

![CORSAIR DDR5-6000MHz デスクトップPC用メモリ VENGEANCE RGB DDR5シリーズ (PC5-48000) Intel XMPメモリキット 32GB ブラック [16GB×2枚] CMH32GX5M2E6000C36 製品画像:7位](https://m.media-amazon.com/images/I/31IE+EONNmL._SL160_.jpg)