AI用語の基礎知識

【第4回】LLM(大規模言語モデル)とは――生成AIを動かす“頭脳”

2026年5月4日 07:00

AIサービスの中核を担う「LLM」

LLMは「Large Language Model(大規模言語モデル)」の略で、ChatGPTやGemini、Claudeといった生成AIサービスの中核を担う技術です。

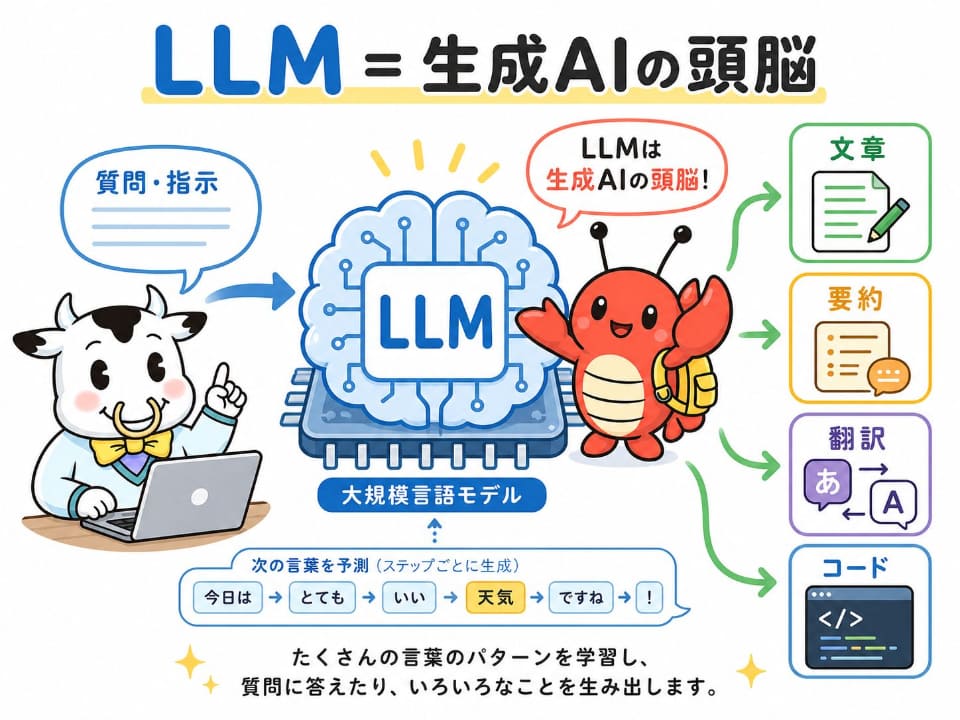

こうしたサービスは、LLMだけで成り立っているわけではありません。画面や音声入力、検索、外部ツール、安全対策など、さまざまな仕組みと組み合わせて提供されています。その中心で、文章を解釈し、生成する「エンジン」の役割を担うのがLLMです。いわば、生成AIの“頭脳”にあたる部分といえます。

LLMの特徴は、その名の通り、膨大なテキストデータと計算資源を使って学習されている点にあります。

LLMの仕組み(大まかに)

LLMは、大量の文章データから「次にどの言葉が来るか」を確率的に予測するよう学習されています。

たとえば「明日の天気は」と入力された場合、「晴れ」、「雨」といった続きが来る可能性を計算し、自然な候補を選びながら文章を生成していきます。このように、単語(正確には「トークン」と呼ばれる単位語)を一つずつ予測することで、文章全体を構成しています。

現在の多くのLLMは、2017年に提案された「Transformer」と呼ばれる技術を土台に発展してきました。

さらに、実際のサービスに使われるLLMでは、用途に合わせて知識や応答傾向を調整する「ファインチューニング」や、人間のフィードバックを取り入れた調整(RLHFなど)も行なわれています。これにより、より自然で実用的な応答ができるようになっています。

LLMによって何が変わったのか

大規模なLLMが普及する以前のAIは、「迷惑メール判定」や「画像認識」など、特定のタスクに特化したものが主流でした。

それに対してLLMは、人間が日常的に使う「自然言語」を幅広く扱えるため、1つのモデルで多様な用途に対応しやすい点が大きな違いです。

文章の作成、要約、翻訳、プログラミング支援など、さまざまな用途を横断的にカバーできる柔軟性こそが、LLMをAIのブレイクスルーとして注目させた理由です。

今後の進化と周辺技術

今後のLLMは、精度向上だけでなく、より長い文脈の理解や、ユーザーの意図をくみ取る応答といった方向へ進化していくと考えられます。

また、テキストだけでなく、画像や音声なども統合して扱う「マルチモーダル化」も進んでいます。

さらに、LLMを中核に据えたAIエージェントの発展によって、単なる応答にとどまらず、実際にタスクを実行するAIの実用化も進んでいます。

一方で、LLMを小型化した「SLM(小規模言語モデル)」も登場しており、スマートフォンなどの端末上で動くAIとしての活用も広がりつつあります。

LLMは生成AIの「頭脳」

LLMは、生成AIを支える基盤技術であり、現在のAIブームの中心にある存在です。

AIサービスは今後も多様化していきますが、その多くはLLMやその周辺技術をベースに進化していくと考えられます。

AIを理解するうえで、まず押さえておきたい基本用語のひとつといえるでしょう。

![CORSAIR DDR5-6000MHz デスクトップPC用メモリ VENGEANCE RGB DDR5シリーズ (PC5-48000) Intel XMPメモリキット 32GB ブラック [16GB×2枚] CMH32GX5M2E6000C36 製品画像:6位](https://m.media-amazon.com/images/I/31IE+EONNmL._SL160_.jpg)

![CORSAIR DDR5-6000MHz デスクトップPC用メモリ VENGEANCE DDR5シリーズ (PC5-48000) AMD EXPO メモリキット 32GB ブラック フレー [16GB×2枚] CMK32GX5M2E6000Z36 製品画像:8位](https://m.media-amazon.com/images/I/310jEGnm7yL._SL160_.jpg)