ニュース

DeepL、「Voice-to-Voice」発表会で音声から音声へのリアルタイム翻訳をデモ

2026年4月16日 19:05

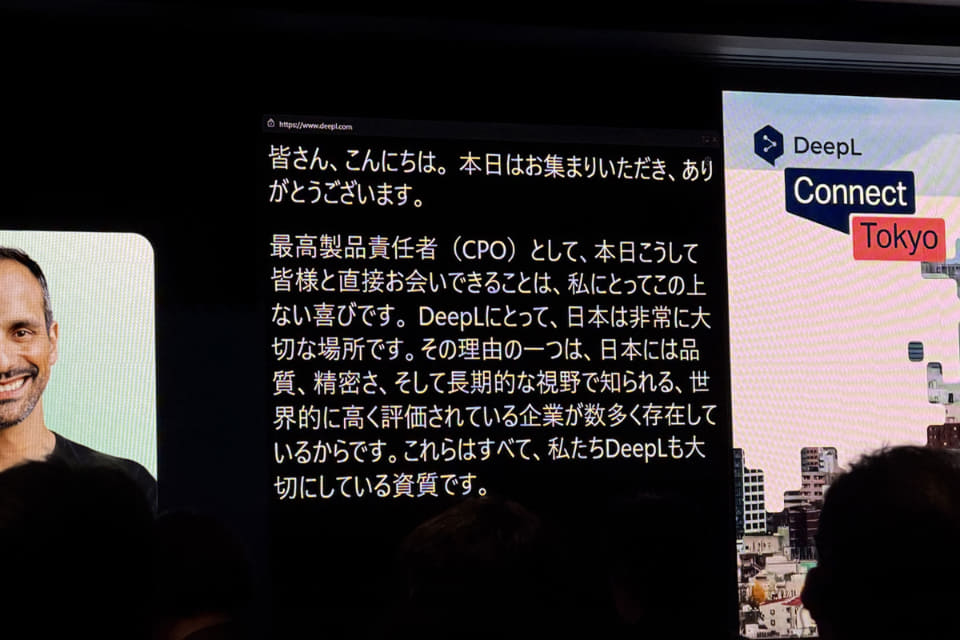

DeepLジャパンは4月16日、リアルタイムAI音声翻訳「DeepL Voice-to-Voice」を発表した。Voice-to-Voiceは、話した言葉をリアルタイムにAIが翻訳を行ない、音声で出力してくれるシステム。今回の発表会では、最高製品責任者のゴンサロ・ガイオラス氏のプレゼンテーションをリアルタイムにAI翻訳を行ない、字幕で表示するとともに、レシーバーからVoice-to-Voiceで翻訳した音声をリアルタイムで流した。

Voice-to-Voiceは、Microsoft TeamsやZoomといったミーティングプラットフォーム上でリアルタイム音声翻訳を提供する「Voice for Meeting」、モバイルデバイスやWeb上で利用できる「Voice for Conversations」、研修やコーチングなど多人数で多言語コミュニケーションが必要な場で、複数のデバイスで同時にリアルタイム音声翻訳を受け取れる「Group Conversations」、そして「Voice-to-Voice API」でラインナップ構成されている。このほかにも発話者の話すスピードや製品用語、製品名などの表現をカスタマイズして品質を最適化する新機能も5月7日より一般提供を開始予定となっている。

提供時期については、Voice for Conversationsは本日から開始されている。Voice for Meetingは6月から早期アクセスを受け付け予定で、現在登録を受け付け中。Group Conversationsは4月30日より提供開始予定、Voice-to-Voice APIは早期アクセス提供中で、登録を受付中。

DeepLはこれまで、音声を翻訳しテキストに変換するソリューションを中心に展開してきたが、これからは音声をリアルタイムに翻訳し、音声出力する分野にも注力していく。先日行なわれた報道関係者向けの説明会でも語られていたが、言葉が通じないことにより意図が通じないことはもちろん、その理解のために時間を要したり、そもそも発言することをためらってしまうことが発生し、目に見える金銭的なコストだけでなく、従業員などの心理的コストとしてもマイナスになっており、ビジネスチャンスが損なわれたり、顧客との関係性にも影響するといったデータが出ているという。

プレゼンテーションでは、会議や、多言語の従業員の研修、カスタマーセンターでの海外顧客の問い合わせ対応など、それぞれのシチュエーションを設定し、Voice-to-Voiceを使用してのデモを行ない解説。会議では日本語と韓国語による会議により会話が通じることにより意思決定が迅速に行なわれ、研修では多言語を操る従業員を前にリアルタイムに会話が成立することで危険な作業状況の情報共有が可能となり、カスタマーセンターでのデモでは顧客満足度の向上につながっていた。DeepLはすべての言語がわかる従業員をそろえることは実現的ではないとし、そういった意味でも翻訳ソリューションの重要性を改めてアピールした。

実際に発表会でVoice-to-Voiceで翻訳されたプレゼンテーションを体験した印象としては、開発中ということもあり、たとえば「3つ(みっつ)」を「さんつ」と発音したり、「大企業(だいきぎょう)」を「おおきぎょう」、「広範囲(こうはんい)」を「ひろはんい」と発音するといった事例が見られた。また、話者が一気にしゃべり続けると、翻訳までに時間のかかる状況も発生していた。

ただ個人的な感覚だが、同時に表示されていたリアルタイム翻訳の字幕を見れば特に迷うこともなく、文章によっては字幕のリアルタイム翻訳よりわかりやすく、音声であるが故かすんなりと頭に入ってくる翻訳も多数あった。また、「ぜひ参加していただければ幸いです」といった話者の心情を日本語らしい表現で翻訳する部分もあり、かなり高精度であると感じられる部分もあった。

ゴンサロ・ガイオラス氏によれば、「現状では品質の面では劣るところもあるが、研究室ではさまざまな研究を行なっており、我々はコストや遅延より品質を最優先して開発を続けている」とし、「しかし、今年後半から来年初頭にかけ技術的ブレイクスルーを達成し、音声から音声への翻訳を一つのモデルとして完結させる技術を確立できる見込みだ」としている。

また、技術的に面白い研究としては、話者の声紋をコピーし、言葉を翻訳後に話者の声に似せた音声で出力するといったことも研究中だとか。また、モバイルなどでオフラインでの利用に関しては、品質と精度、モデルとサイズとのトレードオフにより、何を重要視するかでむつかしい側面があるようだ。これについても、簡略化したモデルでの製品化なども検討していきたいようだ。

![CORSAIR DDR5-4800MHz ノートPC用 メモリ VENGEANCE DDR5 64GB [32GB×2枚] SO-DIMM CMSX64GX5M2A4800C40 (PC5-38400) ブラック 製品画像:8位](https://m.media-amazon.com/images/I/41ryDAa3opL._SL160_.jpg)

![CORSAIR DDR4-3200MHz デスクトップPC用 メモリ VENGEANCE LPX シリーズ 32GB [16GB×2枚] CMK32GX4M2E3200C16 製品画像:9位](https://m.media-amazon.com/images/I/31Hq8-Z9oWL._SL160_.jpg)